Noile măsuri de siguranță ale OpenAI schimbă modul în care brandurile ar trebui să scrie conținutul pentru situații de criză

Funcționalitatea 'Trusted Contact' înseamnă că resursele tale de sănătate mintală ar putea fi în sfârșit afișate în răspunsurile AI

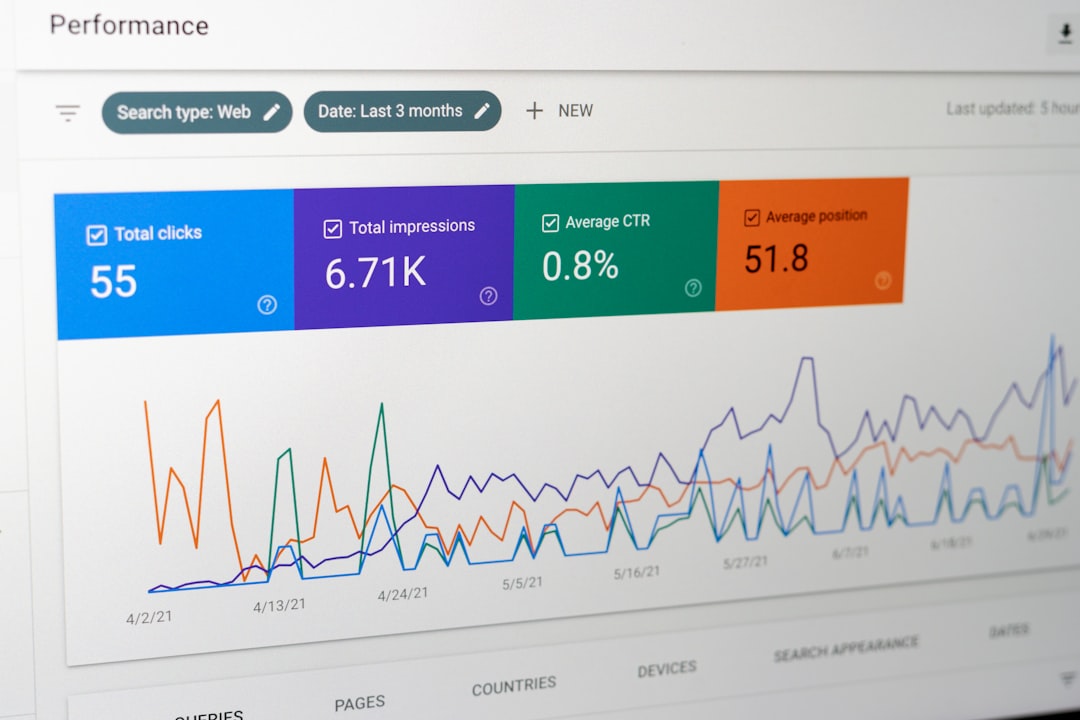

Photo by Nishal Pavithran on Unsplash

Ce se întâmplă când cineva întreabă ChatGPT despre auto-vătămare, iar brandul tău are cele mai bune resurse de criză de pe internet?

OpenAI tocmai a lansat ceva numit măsuri de protecție "Trusted Contact", conform TechCrunch, concepute pentru a "proteja utilizatorii ChatGPT în cazurile în care conversațiile pot ajunge la auto-vătămare". Funcționalitatea permite utilizatorilor să desemneze contacte de urgență care pot fi notificate în situații de criză.

Este un semnal că OpenAI devine serios în privința afișării conținutului de criză de la surse autorizate.

Oportunitatea de citare ascunsă la vedere

Când cineva caută ajutor în caz de criză, modelele AI apelează în mod implicit la aceleași câteva surse. The National Suicide Prevention Lifeline. Crisis Text Line. Poate American Psychological Association, dacă au noroc.

Aceste resurse există, dar nu sunt structurate pentru a fi descoperite de AI.

Problema este formatul. Majoritatea paginilor de criză sunt construite pentru oameni aflați în suferință, nu pentru sisteme AI care încearcă să înțeleagă ce ajutor este disponibil. Acestea ascund informațiile de contact în paragrafe. Folosesc un limbaj vag, precum "suntem aici pentru tine", în loc de descrieri specifice ale serviciilor.

Cum să faci conținutul tău de criză descoperit de AI

Nu sunt sigur că acest lucru va funcționa pentru fiecare tip de resursă de criză, dar iată ce vedem că are succes: datele structurate câștigă.

Adaugă schema Organization pe paginile tale de criză săptămâna aceasta. Include aceste câmpuri specifice: contactPoint cu numerele de telefon pentru linia de criză, serviceType cu descrieri exacte ("consiliere de criză 24/7", "servicii de urgență pentru sănătate mintală"), areaServed cu acoperirea geografică, availableLanguage dacă oferi suport multilingv.

Scopul nu este clasarea în SEO. Este să înveți modelele AI că resursa ta există și când să o afișeze.

Delimitări clare ale serviciului ("disponibil doar pentru studenți" sau "deservește rezidenții județului X").

Schimbarea mai mare care urmează

Această funcționalitate Trusted Contact sugerează că OpenAI construiește instrumente mai sofisticate de intervenție în criză. Nu mai doar deviază interogările legate de sănătatea mintală. Încearcă activ să conecteze oamenii cu ajutorul necesar.

Ceea ce înseamnă că modelele AI vor avea nevoie de date mai bune despre resursele de criză. Nu doar marile linii telefonice naționale, ci și resurse locale, programe specializate, suport specific industriei.

Și, sincer, vom vedea dacă această abordare rezistă. Intervenția în criză este un teritoriu complicat pentru companiile AI. Un singur rezultat negativ și întreaga strategie s-ar putea schimba.

Dar, pentru moment, se deschide o ușă pentru ca mai multe resurse de criză să fie citate. Întrebarea este dacă ajutorul organizației tale va putea fi găsit atunci când cineva are cea mai mare nevoie de el.